نعم ، ربما لا يكون هذا مفاجئًا بشكل مفرط ، لكنه لا يزال بمثابة تذكير مفيد فيما يتعلق بالقيود على الموجة الحالية من أدوات البحث عن الذكاء الاصطناعي ، والتي تدفعك التطبيقات الاجتماعية الآن إلى استخدامها في كل منعطف.

وفقا ل دراسة جديدة أجراها تيانه مركز السحب للصحافة الرقمية، تفشل معظم محركات البحث الرئيسية في الذكاء الاصطناعي في توفير الاستشهادات الصحيحة للمقالات الإخبارية ضمن الاستعلامات ، مع الأدوات غالبًا ما تشكل روابط مرجعية ، أو ببساطة لا تقدم إجابة عند استجوابها على مصدر.

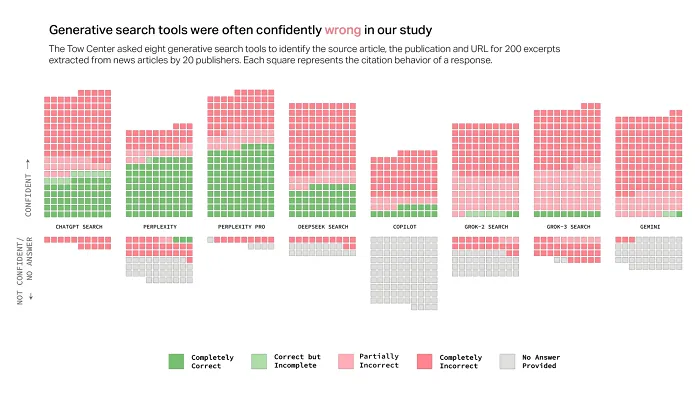

كما ترون في هذا المخطط ، لم تكن معظم أدوات الدردشة الرئيسية منظمة العفو الدولية جيدة بشكل خاص في توفير الاستشهادات ذات الصلة ، مع chatbot Grok’s Xai ، والتي وصفها Elon Musk باسم “الأكثر صدقا” منظمة العفو الدولية، كونه من بين أكثر الموارد غير الدقيقة أو غير الموثوقة في هذا الصدد.

حسب تقرير:

“بشكل عام ، قدمت chatbots إجابات غير صحيحة لأكثر من 60 ٪ من الاستفسارات. عبر منصات مختلفة ، تباين مستوى عدم الدقة ، مع الإجابة على 37 ٪ من الاستعلامات بشكل غير صحيح ، بينما كان لدى Grok 3 معدل خطأ أعلى بكثير ، حيث استجيب 94 ٪ من الاستعلامات بشكل غير صحيح.“

في جبهة أخرى ، وجد التقرير أنه في كثير من الحالات ، كانت هذه الأدوات قادرة في كثير من الأحيان على تقديم معلومات من مصادر تم حبسها إلى Drassing AI:

“في بعض المناسبات ، أجبت chatbots إما بشكل غير صحيح أو رفضت الإجابة على الاستفسارات من الناشرين الذين سمحوا لهم بالوصول إلى محتواهم. من ناحية أخرى ، أجابوا في بعض الأحيان بشكل صحيح على الاستفسارات حول الناشرين الذين لم يكن من المفترض أن يحصلوا على محتواهم. “

مما يشير إلى أن بعض مقدمي الذكاء الاصطناعى لا يحترمون أوامر robots.txt التي تمنعهم من الوصول إلى الأعمال المحمية حقوق الطبع والنشر.

لكن اهتمام Topline يتعلق بموثوقية أدوات الذكاء الاصطناعى ، والتي يتم استخدامها بشكل متزايد كمحركات بحث من قبل عدد متزايد من مستخدمي الويب. في الواقع ، ينمو العديد من الشباب الآن مع chatgpt كأداة بحثية المفضلة لديهم ، ورؤى مثل هذا العرض الذي لا يمكنك الاعتماد عليه ببساطة على أدوات الذكاء الاصطناعى لمنحك معلومات دقيقة ، وتثقيفك حول الموضوعات الرئيسية بأي طريقة موثوقة.

بالطبع ، هذه ليست أخبار ، على هذا النحو. أي شخص يستخدم chatbot منظمة العفو الدولية سيعرف أن الردود ليست دائمًا ذات قيمة أو قابلة للاستخدام بأي شكل من الأشكال. ولكن مرة أخرى ، فإن القلق هو أن نشجع هذه الأدوات كبديل للبحث الفعلي ، واختصار للمعرفة ، وبالنسبة للمستخدمين الأصغر سناً على وجه الخصوص ، قد يؤدي إلى عصر جديد من الأشخاص غير المستنيرين وأقل تجهيزًا ، والذين يسيطرون على منطقهم الخاص لهذه الأنظمة.

رجل الأعمال مارك كوبي لخص هذه المشكلة بدقة جميلة في جلسة في SXSW هذا الأسبوع:

“منظمة العفو الدولية ليست هي الجواب. الذكاء الاصطناعي هو الأداة. مهما كانت المهارات التي لديك ، يمكنك استخدام الذكاء الاصطناعي لتضخيمها. “

نقطة الكوبيين هي أنه على الرغم من أن أدوات الذكاء الاصطناعى يمكن أن تمنحك ميزة ، ويجب أن يفكر الجميع في كيفية استخدامها لتعزيز أدائها ، إلا أنها ليست حلولًا في حد ذاتها.

يمكن لمنظمة العفو الدولية إنشاء مقطع فيديو لك ، ولكن لا يمكن التوصل إلى قصة ، وهي العنصر الأكثر إقناعًا. يمكن أن تنتج الذكاء الاصطناعي رمزًا سيساعدك على إنشاء تطبيق ، لكنه لا يمكنه إنشاء التطبيق الفعلي نفسه.

هذا هو المكان الذي تحتاج فيه إلى مهارات وقدراتك في التفكير الناقد لتوسيع هذه العناصر إلى شيء أكبر ، وبينما ستساعد مخرجات الذكاء الاصطناعي بالتأكيد في هذا الصدد ، فهي ليست إجابة في حد ذاتها.

إن القلق في هذه الحالة بالذات هو أننا نظهر للشباب أن أدوات الذكاء الاصطناعى يمكنهم منحهم إجابات ، والتي أظهرها البحث مرارًا وتكرارًا أنها ليست جيدة بشكل خاص.

ما نحتاجه هو أن يفهم الناس كيف يمكن لهذه الأنظمة توسيع قدراتهم ، وليس استبدالها ، وذلك للحصول على أقصى استفادة من هذه الأنظمة ، تحتاج أولاً إلى الحصول على مهارات بحثية ومهارات تحليلية ، وكذلك الخبرة في المجالات ذات الصلة.